Réseau

Aperçu

La couche réseau et sécurité de Cloud Avenue est portée par la solution NSX-T de vmware. L’implémentation est réalisée à deux niveaux selon le principe suivant :

- une passerelle Edge Tier 0 (T0), contenant un contexte dédié à chaque client, permettant de raccorder les réseaux externes : internet, BVPN Galerie, Cross Connect, administration, etc. La configuration des passerelles Edge T0 est réalisée par la plateforme.

- Une passerelle Edge Tier 1 (T1) permet de gérer les réseaux d’un vDC, dont la configuration est entièrement gérée par vous dans le portail vCD.

À noter !

Il est important de bien choisir les paramètres de configuration des réseaux de vDC car, une fois créés et raccordés à des vApp/VM, ils ne sont plus facilement modifiables, sauf à déconnecter toutes les vApp/VM qui y sont raccordées.

Les plages d’adresses IP sont choisies par vous, généralement dans des plages d’adresses non routables.

Caractéristiques des passerelles Edge

Selon les besoins, plusieurs configurations sont possibles.

| Type de passerelle Edge | Classe de service | Caractéristiques | Réseaux externes raccordés

(recommandations) |

| T0 VRF | Standard | 300 Mbps débit max (*) |

|

| T0 VRF | Premium |

1 Gbps débit max (*) |

|

| Cluster de T0 dédié (**) | Medium |

3,5 Gbps débit max (*)

|

|

| Cluster de T0 dédié | Large |

|

|

| T1 | Standard | 300 Mbps débit max (*)

|

Une interface (unique) pour le raccordement à la T0

|

| T1 | Premium | 1 Gbps débit max (*)

Nécessite une T0 Premium |

|

| Cluster de T1 dédié | Medium | 2,5 Gbps débit max (*)

Nécessite une T0 dédiée |

|

| Cluster de T1 dédié | Large |

Nécessite une T0 dédiée |

(*) Le débit max signifie la bande passante maximum utilisable (aka global throughput) pour la passerelle ou le cluster dédié. Dans les environnements réseau virtualisés (software-defined), il est normal d’observer un léger écart entre la valeur du profil de bande passante et le débit mesuré par des outils de bout en bout tels qu’iPerf. Cet écart peut être lié aux surcouches protocolaire/encapsulation ainsi qu’au comportement du mécanisme de limitation (traffic shaping).

À titre d’exemple, pour un profil à 300 Mbps, un débit TCP mesuré autour de 270–290 Mbps peut se situer dans la plage attendue. Par ailleurs, les mécanismes TCP (slow start / fenêtre de congestion) et les conditions de test (durée, nombre de flux, MTU) peuvent influencer la mesure.

(**) Un cluster dédié (on parle aussi de Edge Provider) fournit un grand nombre de passerelles. Indispensable pour les opérateurs de services nécessitant un grand nombre de T0/T1 dans une même organisation.

Toutes les passerelles fonctionnent en standard en très haute disponibilité. Les débits sont garantis sur la base d’une taille de taille de paquets réseau de 1500 octets.

Cluster de Edge dédié

Par défaut, les passerelles T0 VRF et T1 sont hébergées sur un cluster mutualisé. Il est possible de commander ces passerelles sur un cluster dédié (clusters de T0 et T1 dédiés), pour servir les cas d’usage suivants :

- très gros besoins en bande passante internet.

- organisation à multiples vDC et plusieurs centaines de VM

- souhait du client d’avoir un maximum de composants dédiés sur la plateforme (en complément d’un cluster dédié par exemple)

- besoin de gérer de multiples T0 VRF/T1

À noter !

Le choix du modèle de T0 détermine le modèle de T1 et le nombre de T1 raccordables à la T0 VRF.

Upgrade

Le passage d’une passerelle T0 VRF standard à une T0 VRF Premium ou d’une passerelle T0 VRF Premium à une T0 dédiée sont des opérations nécessitant une planification et occasionnant une coupure de service.

Les configurations NSX

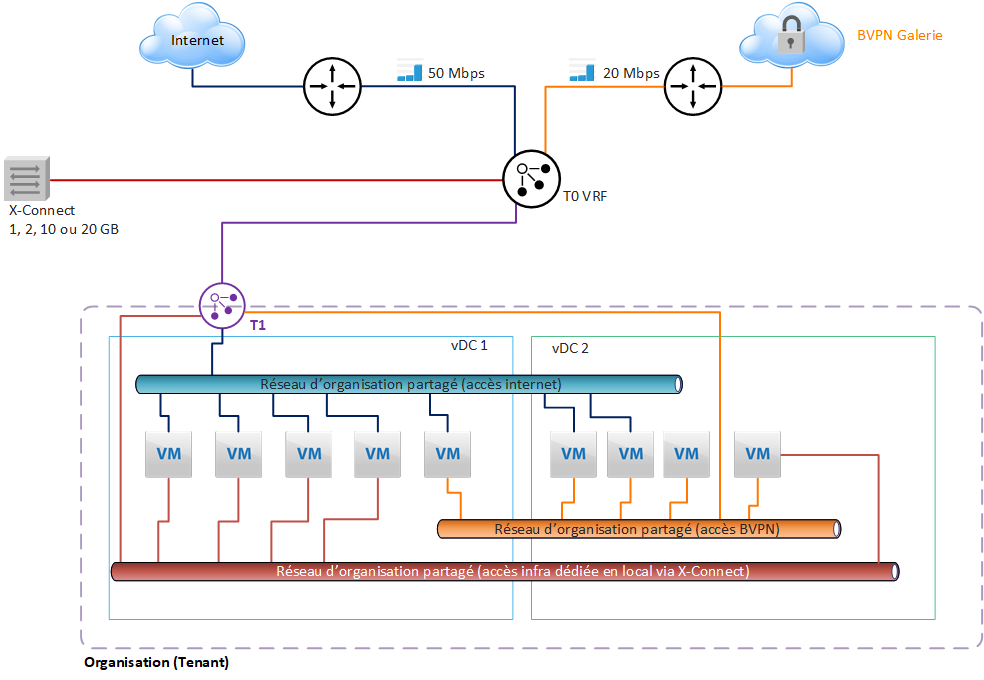

Cas général

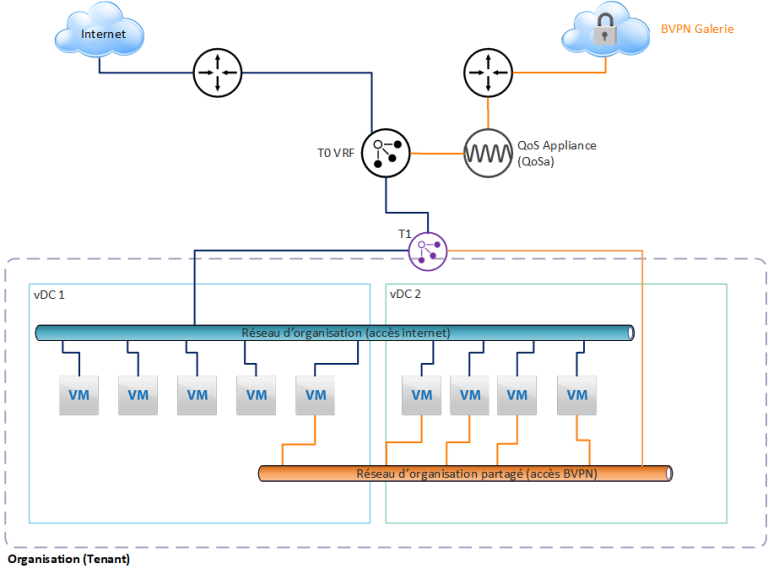

Avec ce principe d’architecture, la bande passante Internet ou VPN Galerie souscrite pour chaque Organisation est paramétrée au niveau de la T0, et partagée entre les différents vDC.

Une passerelle T1 permet de créer des réseaux d’Organisation partageables entre tous les vDC de l’Organisation.

Chaque T1 peut être reliée à une seule passerelle T0, avec une seule interface.

Dans le schéma présenté ici, une passerelle T0 VRF est souscrite par défaut et va gérer l’ensemble des réseaux sous-jacents distribués par la T1 au niveau des vDC

Limitation de la bande passante internet

peut limiter la bande passante d’une passerelle T1. Cela permet de maîtriser le partage de la bande passante entre les différents vDC.

Par contre, la limite de bande passante appliquée à l’interface sortante limitera tous les flux, et pas seulement ceux venant d’internet.

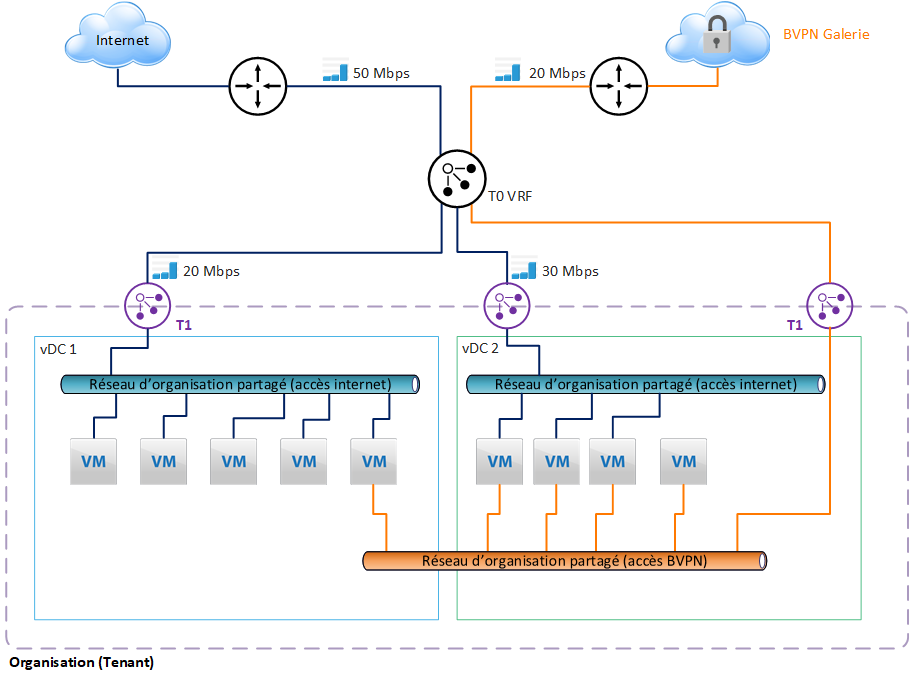

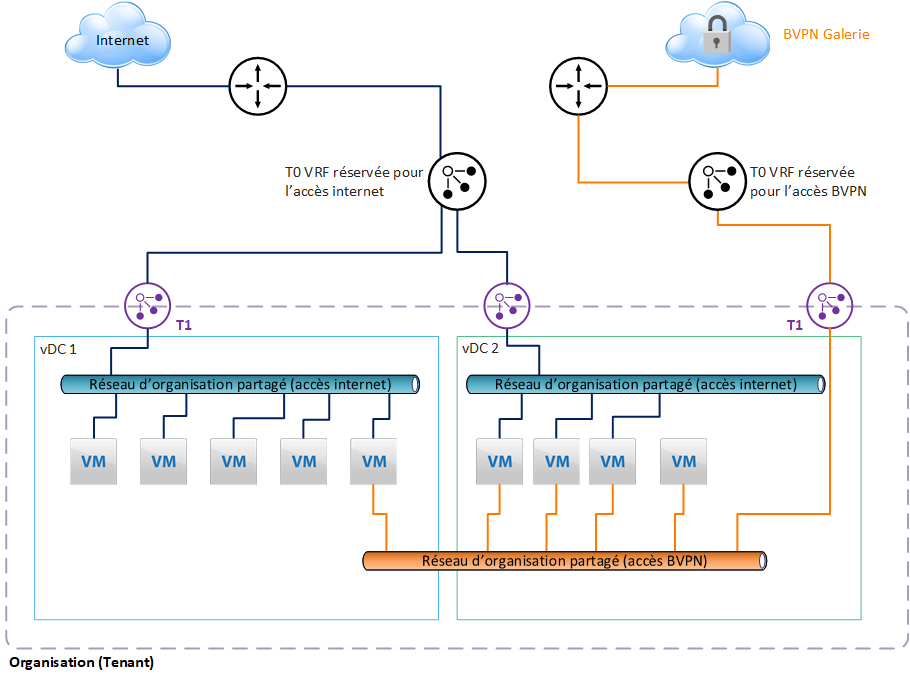

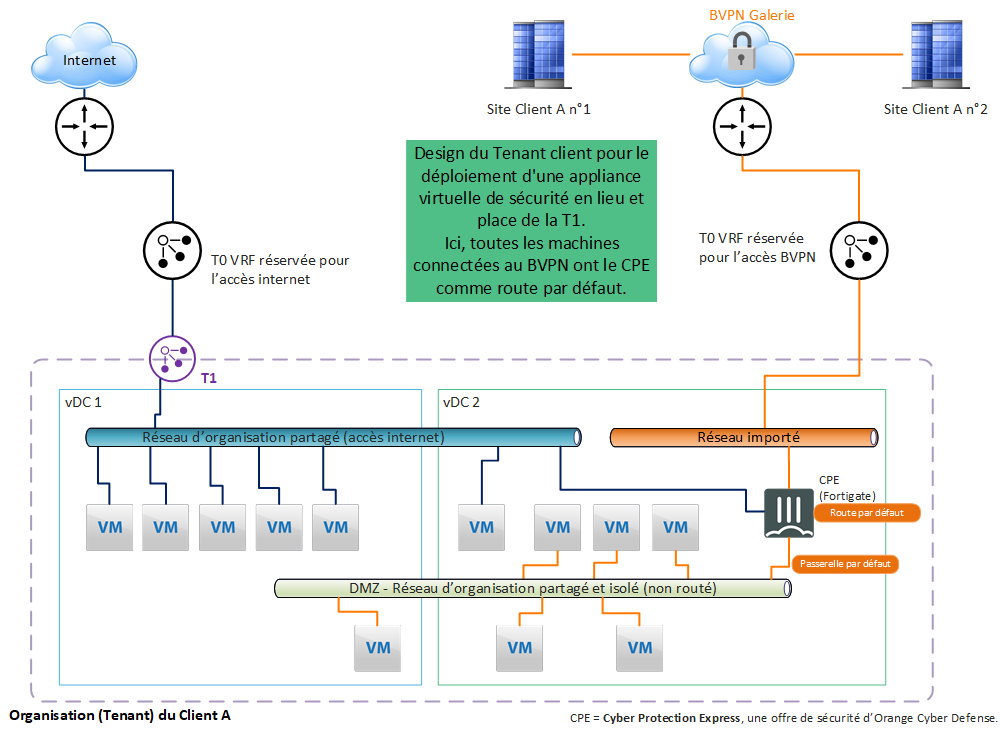

Configuration avec 2 T0 VRF

Pour répondre à des contraintes de politique de sécurité interne, il est possible de séparer les réseaux externes et de leur attribuer une T0 VRF séparée.

Dans notre exemple, on a affectée une T0 VRF pour l’accès internet, et une autre T0 VRF pour l’accès au BVPN Galerie.

Cette séparation est recommandée pour éviter des erreurs de configuration , qui conduiraient à exposer sur internet des réseaux ou des VM qui ne doivent pas l’être. En effet, la configuration de chaque réseau externe se fera dans 2 passerelles différentes dans VCD.

A noter que si l’architecture cible du Client nécessite plusieurs T0 VRF, il faut considérer l’option T0 dédiée, qui permet d’avoir jusqu’à 100 T0 VRF par T0 dédiée.

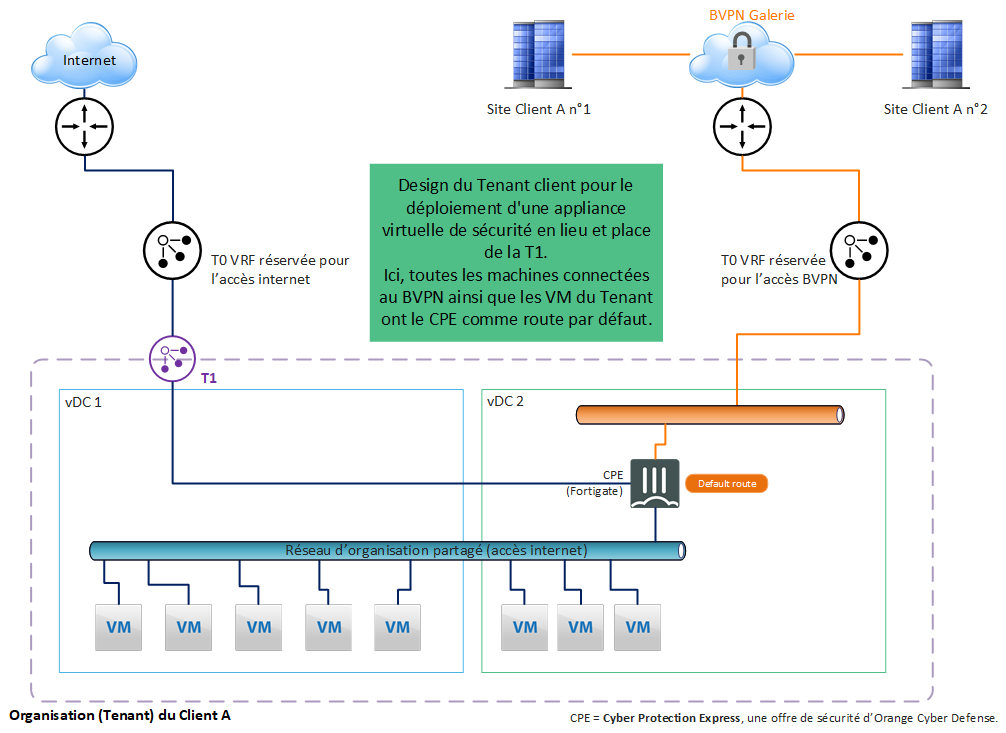

Configuration avec CPE – option 1

Pour quel cas d’usage ?

Lorsque le cl souhaite mettre en place une solution d’évasion internet sécurisée, basée sur une appliance de sécurité dédiée à cet usage.

Caractéristiques de ce design

- Design validé avec l’offre Cyber Protection Express (CPE) d’Orange Cyber Defense

- la T0 VRF connectée au BVPN du client est directement raccordée à l’appliance de sécurité. Plus besoin de T1.

- la T1 connectée à la T0 VRF internet est en mode « transparent », c’est à dire qu’aucune fonction de sécurité n’est activée, puisque tous les flux passent par le CPE, c’est cette dernière qui gère la sécurité du tenant.

- Toutes les VM du tenant sortent sur internet par le CPE

- Tous les ordinateurs raccordés au BVPN du client (sur ses sites) ont une route par défaut, pour accéder à internet, qui est le CPE localisé dans le tenant Cloud Avenue.

Configuration avec CPE – option 2

Pour quel cas d’usage ?

Lorsque vous souhaitez mettre en place une solution d’évasion internet sécurisée, basée sur une appliance de sécurité dédiée à cet usage.

Caractéristiques de ce design

- Design validé avec l’offre Cyber Protection Express (CPE) d’Orange Cyber Defense

- la T0 VRF connectée au BVPN du client est directement raccordée à l’appliance de sécurité. Plus besoin de T1.

- la T1 connectée à la T0 VRF internet assure la sécurité des VM connectées à son réseau (le bleu).

- le CPE assure la sécurité des VM connectées sur un réseau isolé (une DMZ) ; ces VM ont une passerelle par défaut qui est le CPE.

- Tous les ordinateurs raccordés au BVPN du client (sur ses sites) ont une route par défaut, pour accéder à internet, qui est le CPE localisé dans le tenant Cloud Avenue.

Upgrade

Le passage d’une passerelle T0 VRF standard à une T0 VRF Premium est réalisable sans interruption de service dans la majorité des cas (validation technique à obtenir du support en préambule). Le passage d’une passerelle T0 VRF Premium à une T0 dédiée est une opération lourde avec coupure de service et nécessite une planification. Ces opérations sont réalisées à partir d’une demande de changement soumise à partir de l’Espace Client Cloud.

Avec Upgrade d’une GW Standard vers Premium ou vers Cluster Dédiée Tout changement de passerelle implique une reconfiguration qui implique une interruption de service. Les modifications à apporter se font d’une part au niveau client pour la partie GW T1, et au niveau Provider pour la partie TO. En fonction de la configuration existante et de sa complexité (exemple nombre de règles FW) l’upgrade peut être plus ou moins long. Il est préférable de surdimensionner la taille de la Gateway lors de l’implémentation initiale.

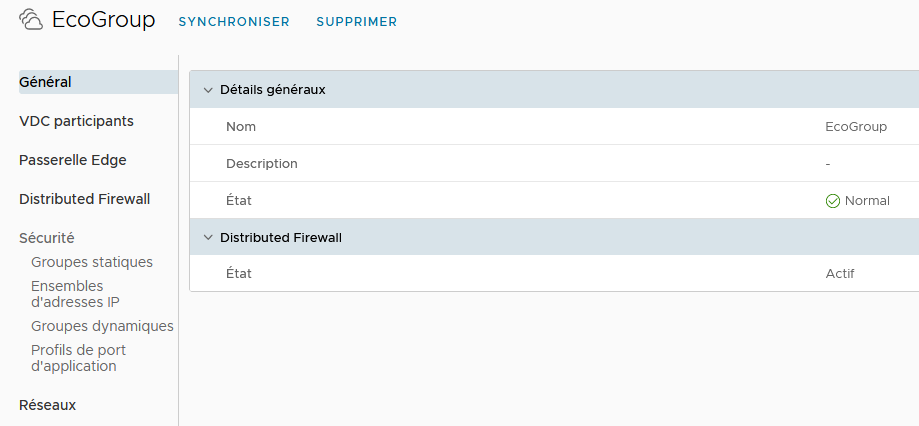

Groupe de vDC

Aperçu

Dans la nomenclature VDC, on distingue deux types de vDC

- les vDC isolés, ne faisant pas partie d’un groupe de vDC,

- les vDC groupés, faisant partie d’un groupe de vDC.

Par défaut :

- un vDC est isolé,

- le contexte réseau et sécurité de chaque vDC est étanche.

A la création d’une organisation, un premier groupe de vDC est créé.

Avantages du groupe de vDC

Un groupe de vDC permet :

- de partager une passerelle T1 entre les vDC membres du groupe ; les réseaux et services portés par cette T1 seront partagés entre tous les vDC

- d’activer le Firewall distribué pour l’ensemble des vDC membres.

Un groupe de vDC représente donc un contexte réseau/sécurité commun à l’ensemble des vDC membres de ce groupe.

Facturation

Le premier groupe de vDC est inclus dans le prix du service.

Voir la fiche tarifaire pour le prix d’un groupe de vDC supplémentaire.

Fonctionnalités intégrées

Réseau d’organisation

La passerelle Edge T1 permet de créer les réseaux internes du vDC sur lesquels seront raccordées les VM. L’adressage de ces réseaux est choisi par vous lors de la configuration ou de la création. Pour partager les réseaux entre vDC, il est nécessaire de créer un groupe de vDC, incluant les vDC concernés, qui pourront alors partager les fonctionnalités de la passerelle Edge T1 et ses réseaux.

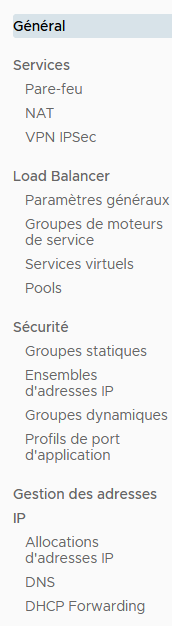

Pare-feu

La passerelle T1 propose un pare-feu à 2 niveaux :

- pare-feu périmétrique, pour les flux nord-sud, c’est à dire entrants et sortants du vDC (ou du groupe de vDC)

- pare-feu distribué, pour les flux est-ouest, sur un scope allant d’un seul vDC à l’ensemble des vDC inclus dans un groupe de vDC..

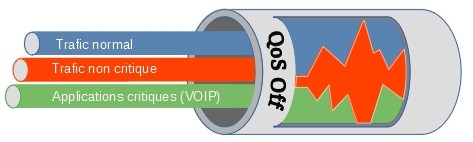

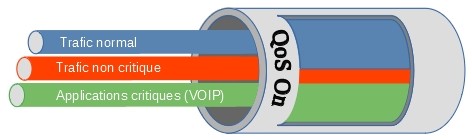

La bande passante entrante ne nécessite pas de gestion de la QoS, étant donné que les bandes passantes internes disponibles sont suffisantes, avec un cœur de réseau à plusieurs dizaines de Gbps. En revanche, la bande passante sortante doit être gérée avec un mécanisme de priorisation de flux, surtout lorsque des applications de type temps réel ou de voix sur IP sont utilisées, avec une bande passante limitée sur le BVPN du Client. Il est dans ce cas nécessaire d’utiliser une appliance de QoS.

La configuration du pare-feu périmétrique sera réalisée dans les options Services de la configuration de la passerelle Edge T1. Tous les flux entrants et sortants du vDC seront filtrés via les règles implémentées ici. Il sera également possible de configurer un VPN IPSec point à point entre l’équipement distant et la passerelle Edge T1.

Un Load Balancer est également disponible, proposant des fonctionnalités de base pour la mise en grappe de serveurs.

L’option Sécurité va permettre de gérer une partie de la configuration liée au pare-feu distribué. C’est là qu’il faut définir les groupes de sécurité qui portent les autorisations définies ensuite dans la configuration du pare-feu (voir ci-dessous).

La Gestion des adresses IP permet de configurer les services IP avancés de la passerelle Edge T1, comme la redirection DNS ou DHCP.

Dans la configuration du groupe de vDC, on va pouvoir configurer le pare-feu distribué, et définir des autorisations assez fines au niveau des groupes de sécurité.

Cette fonctionnalité extrêmement puissante permet :

- de protéger efficacement les VM en filtrant les flux est-ouest

- de créer des zones de confiance basées sur des tags positionnés manuellement sur les VM ou construits dynamiquement à partir de règles programmées

Toutes les fonctionnalités décrites ci-dessus sont configurables par vos soin dans le portail vCloud Director.

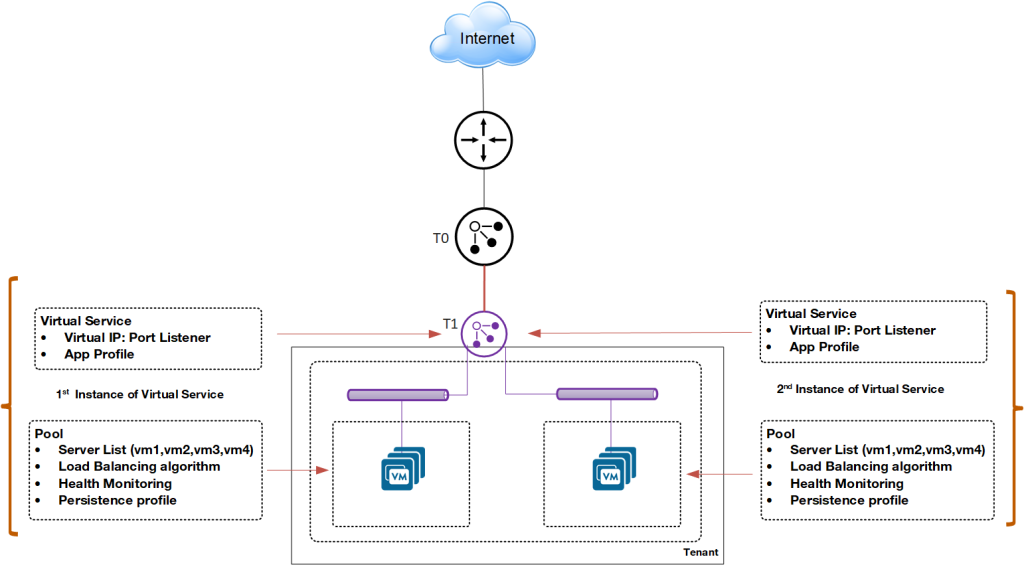

Load Balancer as Service (LBaaS)

Vue d’ensemble

Le service de load balancer dans Cloud Avenue est fourni par la solution NSX Advanced Load balancer (NSX ALB) de VMware.

La mise en œuvre est effectuée au niveau de la passerelle T1 dans un vDC ou un « Data center group » (c’est-à-dire un groupe de plusieurs vDC) s’ils sont connectés à la même passerelle T1 dans la même AZ (Chartres ou Val de Reuil).

Vous pouvez créer/gérer la configuration des load balancers à partir de l’interface utilisateur du tenant (portail vCloud Director – VCD).

Advanced Load Balancer – mutualisé et dédié

Les services de load balancer disponibles sur Cloud Avenue IaaS sont les suivants :

| Type de LBaaS | Exigences de configuration | Quota de classe de service par défaut | Résilience du moteur de Load Balancing |

| Mutualisé | T0 VRF Premium | 20 VIP | Actif / Standby Actif / Actif |

| Dédié | T0 VRF Premium | 200 VIP | Actif / Standby Actif / Actif |

Les services de load balancer disponibles sur Cloud Avenue Privé (« VCOD ») sont les suivants :

| Type de LBaaS | Exigences de configuration | Quota de classe de service par défaut | Résilience du moteur de Load Balancing |

| Dédié | T0 Dédié Medium | 200 VIP par Service Engine | Actif / Standby Actif / Actif |

| Paramètres de configuration | IAAS (Cloud Avenue Mutualisé) | VCOD (Cloud Avenue Privé) | |

|---|---|---|---|

| Type d’application | HTTP | ▲ | ▲ |

| HTTPS | ▲ | ▲ | |

| L4 TCP | ▲ | ▲ | |

| L4 UDP | ▲ | ▲ | |

| L4 TLS | ▲ | ▲ | |

| Algorithme de répartition de la charge | Least Connections | ▲ | ▲ |

| Round Robin | ▲ | ▲ | |

| Consistent Hash | ▲ | ▲ | |

| Fastest Response | ▲ | ▲ | |

| Least Load | ▲ | ▲ | |

| Fewest Servers | ▲ | ▲ | |

| Random | ▲ | ▲ | |

| Fewest Tasks | ▲ | ▲ | |

| Core Affinity | ▲ | ▲ | |

| Persistance du pool | Client IP | ▲ | ▲ |

| HTTP Cookie | ▲ | ▲ | |

| Custom HTTP Header | ▲ | ▲ | |

| Application Cookie | ▲ | ▲ | |

| Client IP | ▲ | ▲ | |

| Moniteur de santé actif | HTTP | ▲ | ▲ |

| HTTPS | ▲ | ▲ | |

| TCP | ▲ | ▲ | |

| UDP | ▲ | ▲ | |

| PING | ▲ | ▲ | |

| Analyse | Dashboard | ▲ | ▲ |

| Fonctionnalités avancées | HTTP Policy | ▲ | ▲ |

| WAF | ▲ | ▲ | |

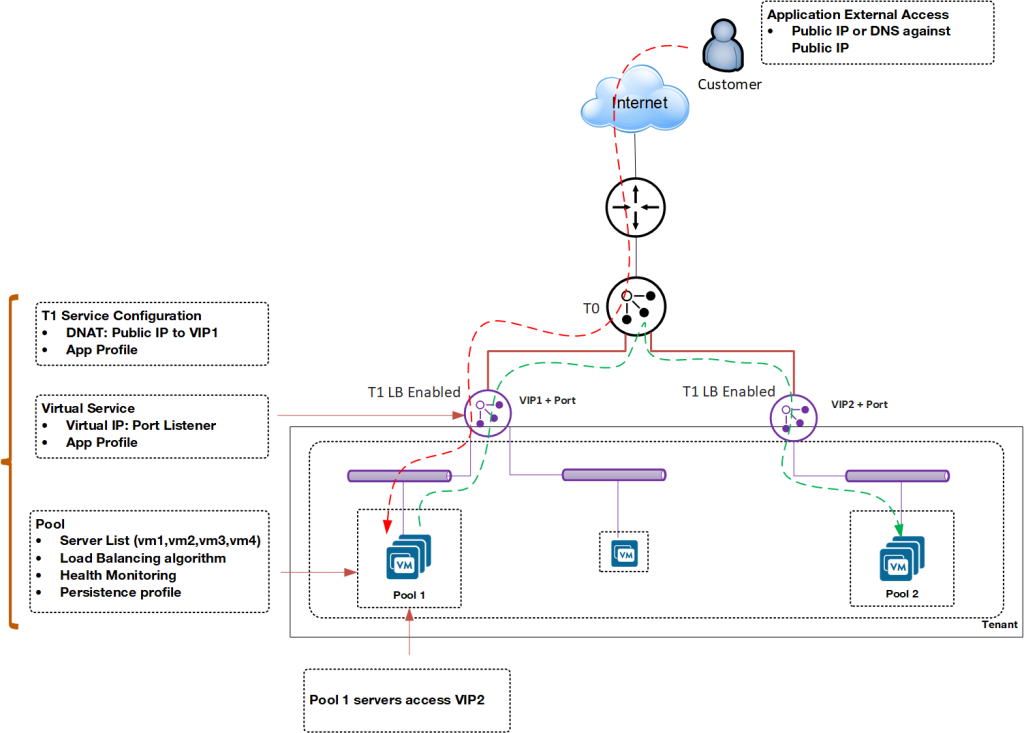

Schéma général du load balancer

Une option de load balancer est disponible sur la passerelle T1.

Vous pouvez créer :

- Des Services virtuels : Un service virtuel est une combinaison d’une adresse IP et d’un port qui utilise un seul protocole réseau. Un service virtuel est à l’écoute du trafic vers une adresse IP.Il traite les demandes des clients et dirige les demandes valides vers un membre du pool de serveurs de load balancer.

- Des Pools : Un pool de serveurs est un groupe d’un ou plusieurs serveurs que vous configurez pour exécuter la même application et assurer une haute disponibilité.

- Des Profils d’application : Les profils d’application déterminent le comportement des services virtuels en fonction du type d’application. Les types de profils d’application, par exemple HTTP, HTTPS, L4 TCP, L4 UDP, L4 TLS, peuvent être utilisés.

Load Balancer externe et interne

En fonction des besoins de configuration vous pouvez déployer le load balancer pour les applications internes et externes.

Dans cet exemple, le pool 1 exécute une application tournée vers l’extérieur. Les serveurs du pool 1 accèdent au pool 2, qui exécute une application tournée vers l’intérieur.

Mise à niveau (Upgrade)

Cloud Avenue Mutualisé : Nombre de services virtuels

Si vous avez besoin de créer des Load balancer en plus de ceux qui vous sont est attribués par défaut à l’ouverture de votre tenant, vous avez la possibilité de demander un pack de services virtuels supplémentaire.

Cloud Avenue Privé : Comptage des unités de service (cores)

Vous pouvez demander un upgrade pour le moteur du load balancer, c’est-à-dire augmenter le nombre de cœurs du moteur (vCPU). Par défaut, votre moteur de load balancer est provisionné avec le nombre de cœurs que vous avez indiqué dans votre bon de commande.

Options de l’interface utilisateur

Cloud Avenue Mutualisé

Si vous disposez de l’offre Cloud Avenue Mutualisé vous disposez par défaut du portail de gestion du tenant vCloud Director comme interface en libre-service pour créer/gérer des services virtuels avec des fonctionnalités avancées associées comme les HTTP Policy ou le WAF.

Cloud Avenue Privé

Si vous disposez de l’offre Cloud Avenue Privé les types d’interface disponibles dépendent des options que vous avez choisies, en particulier si vous n’avez pas choisi l’option de portail de gestion du tenant vCloud Director :

- Si vous avez opté pour vCloud Director vous l’utiliserez pour créer/gérer des services virtuels avec des fonctions avancées associées telles que HTTP Policy, WAF.

- Si vous n’avez pas opté pour vCloud Director vous disposerez de l’interface NSX Advance Load Balancer pour créer/gérer dans votre tenant des services virtuels avec des fonctionnalités avancées associées telles que HTTP Policy, WAF.

Fonctionnalités Avancées

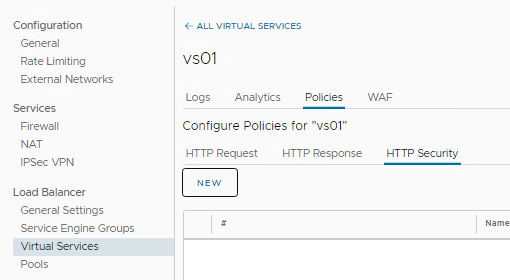

Politique HTTP

Les politiques HTTP des services virtuels permettent de contrôler la sécurité, les attributs des requêtes des clients et les attributs des réponses des applications.

Une politique de service virtuel se compose de critères de correspondance et d’actions qui fonctionnent de la même manière qu’une instruction « si-alors ». Si les critères de correspondance sont remplis, les actions définies sont exécutées.

Les règles HTTP ne peuvent être configurées que pour un service virtuel « layer-7 ».

- Règles sur les requêtes HTTP : Utilisez les règles de requête HTTP pour modifier les requêtes avant qu’elles ne soient transmises

- Règles de réponse HTTP : Utilisez les règles de réponse HTTP pour évaluer et modifier la réponse et les attributs de réponse renvoyés par l’application.

- Règles de sécurité HTTP : Les règles de sécurité HTTP permettent d’autoriser ou de refuser certaines requêtes, de fermer la connexion TCP, de rediriger une requête vers HTTPS ou d’appliquer une limite de débit.

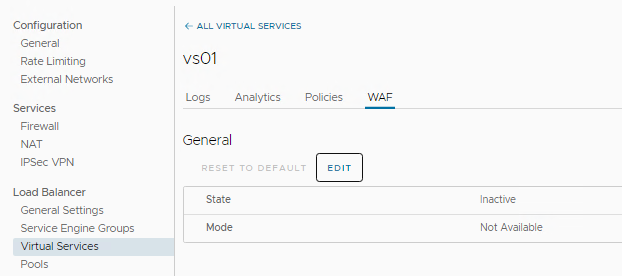

Web Application Firewall (WAF)

Le Web Application Firewall (WAF) peut être activé pour un service virtuel. Deux modes WAF sont disponibles :

Mode de détection :

La politique du WAF évalue et traite la requête entrante, mais n’effectue pas d’action de blocage. Une ligne de log est crée lorsque la requête est flaggée

Mode d’application :

La politique du WAF évalue la demande et la bloque sur la base des règles spécifiées. La ligne de log correspondante est marquée comme REJECTED (rejetée).

Appliance de QoS

Aperçu

La qualité de service, ou QoS (quality of service) désigne un mécanisme permettant d’assurer la priorisation des flux les plus importants dans une bande passante limitée. Les clients qui utilisent leur accès BVPN pour se connecter à leur système d’information hébergé sur Cloud Avenue peuvent rencontrer des problèmes de contention lorsque la bande passante souscrite sur l’accès BVPN du site est limitée. Les applications de type « temps réel » , la plupart du temps des applications de communication (téléphonie sur IP, visioconférence, etc.), vont fortement pâtir de cette contention et vont avoir une baisse significative de la qualité du son et de l’image.

Implémentation

Une Appliance QoS est déployée entre la T0 VRF et le routeur d’accès au réseau BVPN Galerie. Les flux sortants sont filtrés et priorisés sur la base du marquage DSCP des trames réseau.

L’Appliance QoS est déployée en HA (2 VM en cluster), dans la zone de services, et managée par la plateforme de Cloud Avenue.

Prérequis

Les applications critiques doivent marquer les flux selon le standard DSCP. Pour plus d’informations sur le DSCP, rendez-vous sur cette page :

https://fr.wikipedia.org/wiki/Differentiated_Services_Code_Point

Mise en place

La commande est réalisée à partir de l’Espace Client, à l’aide d’une demande de changement pour l’instant.

Facturation

La QoS Appliance (QoSa) est déployée à la demande, et est facturée au mois, en fonction du modèle choisit. Il existe trois modèles :

| Modèle de QoSa | Débit Max de l’Appliance |

| Small | 50 Mbps |

| Large | 500 Mbps |

| X-Large | 2 Gbps |

Se référer à la Fiche Tarifaire pour les prix.