Stockage Réseau

Aperçu

Le stockage externe est accessible pour vos VM via des adresses IP et selon les protocoles que vous choisissez. Le stockage réseau est toujours fourni en mode dédié.

La technologie que nous utilisons vous offre, en tant que Client, un SVM (Storage Virtual Machine) pour chaque Tenant, garantissant un contexte dédié et sécurisé.

Classes des services

| Classe de services | Performance |

Taille minimum |

Classe de disponibilité |

|

|

One site |

Dual site asynchrone |

|||

| Silver | 600 IOPS/To | 500 Go | ▲ | ▲ |

| Gold | 1000 IOPS/To | 500 Go | ▲ | ▲ |

| Platinium 3k | 3000 IOPS/To | 500 Go | ▲ | ▲ |

La quantité d’IOPS effectivement fournie correspond au volume de stockage commandé fois le nombre d’IOPS/Go de la classe de service souscrite.

Le service Dual site asynchrone signifie un RPO minimal de 15 minutes.

Noter par ailleurs que la performance en IOPS est lié à la taille des blocs traités.

Exemple :

500 Go de stockage réseau Platinum 3K permettent d’utiliser de manière permanente 1500 IOPS, indépendamment du nombre de VM utilisant ce stockage.

Sauvegarde

En général, vous établissez vous-même la politique de « snapshot » pour votre stockage réseau.

Protection des données par snapshots NAS

Sauvegarde locale

La sauvegarde NAS est un service permettant de sauvegarder localement ou à distance (cross-site) la solution de stockage NAS.

Un client peut effectuer une sauvegarde manuelle ou planifiée d’un snapshot de base pour chaque volume. Les snapshots sont des images en lecture seule du système de fichiers à un instant précis, stockées localement dans l’espace du volume.

Le nombre maximum de snapshots par volume est limité à 1000.

Si le client souhaite planifier des snapshots sur ses volumes, il peut définir une politique de snapshots par volume à partir d’une liste de politiques prédéfinies :

| Nom de la politique | Fréquence | Nombre de snapshots journaliers | Nombre de snapshots hebdomadaires | Nombre de snapshots mensuels | Autres |

|---|---|---|---|---|---|

| cust_pol_hourly-6-daily-7 | Horaire | 6 | 7 | – | – |

| cust_pol_daily-7 | Quotidien | – | 7 | – | – |

| cust_pol_daily-7-weekly-4 | Quotidien / Hebdomadaire | – | 7 | 4 | – |

| cust_pol_daily-7-weekly-4-monthly-3 | Quotidien / Hebdomadaire / Mensuel | – | 7 | 4 | 3 |

Sauvegarde à distance

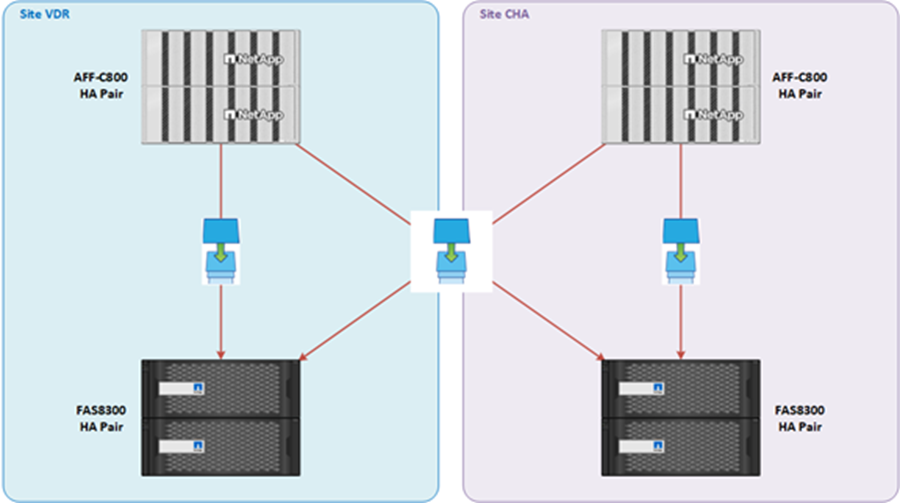

Pour sécuriser les données avec une solution de sauvegarde externe, une baie de stockage de sauvegarde est fournie par site.

Le client peut choisir de sauvegarder ses volumes sur le même site que la production ou sur un site distant, comme illustré ci-dessous :

Le mécanisme de sauvegarde repose sur la technologie NetApp SnapMirror®, qui permet de répliquer les données et snapshots de volumes entre deux baies de stockage NetApp, avec une rétention identique ou différente entre la source et la destination.

Les sites local et distant ne sont pas incompatibles à partir du même volume source. Un client peut choisir de sauvegarder un volume uniquement sur le même site, uniquement sur le site distant ou sur les deux.

La fréquence de planification et la rétention sur les baies de stockage de sauvegarde peuvent être sélectionnées parmi une liste de politiques.

Au sein du même site physique, la baie de sauvegarde est située dans une pièce différente de celle de la baie principale.

La limite d’IOPS par volume est fixée à 600 IOPS par To.

Demande de provisionnement de sauvegarde NAS

Le provisionnement de la sauvegarde NAS doit être effectué par l’équipe CAV OPS, car cette fonctionnalité est déjà supportée dans le catalogue de stockage CAV.

Voici le processus à suivre :

Veuillez envoyer un email au service support CAV : obs-cloud-z3.servicedesk@orange.com.

Stockage réseau « one site »

Dans cette configuration, c’est le stockage local qui est utilisé pour stocker les snapshots.

L’espace occupé par les « snapshots » est déduit de votre quota. Selon la politique que vous choisissez, vous pouvez réserver entre 5 et 20 % de votre stockage total pour les « snapshots ». Cependant, vous pouvez activer les « snapshots » même sans espace réservé.

Stockage réseau « dual site répliqué »

Concept & Architecture

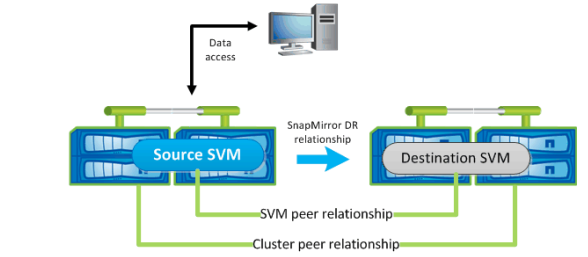

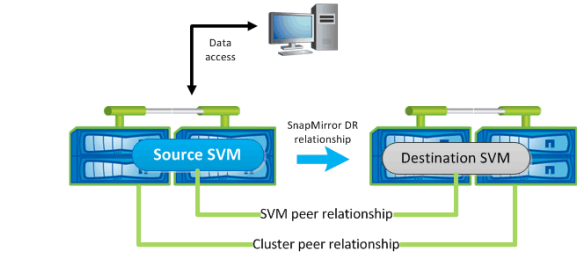

Concept de la Reprise d’Activité (DR) SVM

Le concept de la Reprise d’Activité SVM repose sur la mise en miroir asynchrone des données et de la configuration SVM. Vous pouvez choisir de répliquer tout ou partie de la configuration SVM (c’est-à-dire en excluant la configuration réseau et protocole).

Cela permet de sécuriser un SVM en le répliquant, via snapmirror (fonction interne de NetApp), sur un autre cluster NetApp. Ainsi, si le cluster source tombe en panne ou si le SVM cesse de fonctionner, nous pouvons remettre le SVM en service plus rapidement que si nous restaurions les données. Cela peut également être utilisé pour avoir une Reprise d’Activité sur deux sites.

Le logiciel Snapmirror permet de répliquer directement le SVM vers un autre cluster. Gardez à l’esprit que les éléments répliqués dépendent de la configuration.

Il existe deux façons de le configurer :

- « identity preserve » défini sur Vrai : réplique l’intégralité de la configuration SVM

- « identity preserve » défini sur Faux : réplique uniquement les volumes et les configurations d’authentification et d’autorisation du SVM, ainsi que les paramètres de protocole et de service de noms listés dans les Configurations répliquées dans les relations de reprise d’activité SVM.

Pour récupérer d’un sinistre, vous devez activer le SVM de destination.

Activation du SVM de destination

L’activation du SVM de destination implique :

- la mise en veille des transferts SnapMirror planifiés,

- l’interruption de tout transfert SnapMirror en cours,

- la rupture de la relation de reprise d’activité (DR) SVM

- l’arrêt du SVM source

- le démarrage du SVM de destination.

Prérequis & Limitations

- Les SVM doivent utiliser des volumes FlexVol sur les clusters (volume infini non supporté).

- Un cluster source ou de destination dans une configuration MetroCluster est supporté, mais nous n’effectuons pas de SVM DR sur des SVM qui sont dans une configuration MetroCluster.

- Les clusters source et de destination doivent avoir une licence snapmirror.

- Les clusters source et de destination doivent être appairés.

- Le SVM source peut être sur une configuration de nœud MetroCluster, mais s’il bascule vers l’autre nœud, sa relation SVM DR sera rompue et ne fonctionnera plus. Donc le SVM source doit être sur une configuration MetroCluster OU dans une configuration SVM DR mais pas les deux.

- Le SVM source ne doit pas contenir de DP (protection des données) ou TDP (protection des données de transition)

- Le SVM source ne peut pas être un SVM de destination snapmirror.

- Le SVM source ne doit pas contenir de volume résidant dans un agrégat compatible FabricPool.

- Le volume racine du SVM source ne doit contenir aucune autre donnée en dehors des métadonnées car le volume racine ne sera pas répliqué, sauf les métadonnées du volume racine telles que les jonctions de volume, les liens symboliques, les répertoires menant aux liens symboliques de jonctions.

- Le chemin de consolidation d’audit CIFS doit être sur un volume non racine

- Le volume racine du SVM ne doit pas avoir de qtrees

- Le cluster de destination doit avoir au moins un agrégat non racine avec un espace suffisant (données répliquées).

- Si des volumes parents de clone ou enfants de clone sont déplacés à l’aide de la commande volume move, alors vous devez déplacer le volume correspondant sur le SVM de destination.

- Le client doit demander que le VLAN de stockage source soit tagué sur le DCI. Ticket vers L2 Network ? (discussion en cours pour configurer automatiquement le VLAN de stockage sur le DCI)

- Si le T0 n’est pas étendu, le client doit fournir tous les sous-réseaux des VM et les passerelles de stockage T0 sur le site DR qui doivent contacter le VLAN de stockage.

Information

- Tous les volumes seront répliqués. Une évolution aura lieu ultérieurement pour permettre de choisir/exclure des volumes de la configuration DR.

- Le réseau du SVM sera toujours répliqué dans la configuration SVM DR.

Options de configuration RPO

La réplication DR prend en charge des intervalles RPO configurables avec des options de planification granulaires, permettant aux locataires de sélectionner des niveaux de protection des données appropriés en fonction de leurs exigences métier et de leurs évaluations de criticité :

Intervalles de 15 minutes : De 15 minutes à 1 heure (15, 30, 45, 60 minutes)

- Protection maximale des données pour les charges de travail critiques

- Points de récupération à grain fin pour les applications critiques

Intervalles horaires : De 1 heure à 12 heures (1, 2, 3, 4, 6, 8, 12 heures)

- 1 heure : Protection équilibrée pour les charges de travail importantes

- 4 heures : Protection standard pour les charges de travail normales

- 12 heures : Protection optimisée en coût pour les charges de travail non critiques

Facturation

Le stockage pris en compte est la moyenne de l’espace réservé par vous au cours du mois de référence. La quantité d’IOPS réellement fournie correspond au volume de stockage commandé multiplié par le nombre d’IOPS/Go de la classe de service souscrite.

Exemple : 500 Go de stockage réseau Platinum 3K permet d’utiliser de manière permanente 1500 IOPS, indépendamment du nombre de VM utilisant ce stockage.

Un prix forfaitaire mensuel est appliqué dès la création d’un premier SVM.

La signification des abréviations TB ou To dans notre grille tarifaire est alignée sur celle que vous voyez dans les consoles techniques (VCD, NSS, …)

L’utilisation du stockage Cloud Avenue est calculée en gigaoctets binaires (GB), où 1 GB équivaut à 2^30 octets. Cette unité de mesure est également connue sous le nom de gibibyte (GiB), définie par la Commission électrotechnique internationale (IEC). De même, 1 TB correspond à 2^40 octets, c’est-à-dire 1024 GB.

Principes et limites

- iSCSI n’est pour l’heure pas disponible directement sur le portail de stockage partagé.

- Les volumes peuvent être soit Unix, soit Windows (pas de mode mix)

- Vous pouvez créer jusqu’à 6 volumes par SVM en self-care, avec une taille variant entre 500 Go et 10 To. Pour des volumes supplémentaires ou supérieurs à 10 To, une demande doit être soumise via un ticket. Un volume de plus de 10 To appliquera la même politique de QOS que celle de 10 To (capping).

- Le partage/exportation se fait au niveau de l’arborescence.

- Un partage (Windows) est créé sur un qtree Windows sur un volume Windows.

- Une exportation est créée dans une arborescence Unix sur un volume Unix.

- Les APIs sont compatibles REST API.